超過一千位知名人工智能專家與研究領導人,已經共同簽署了一份「軍用人工智能軍備競賽」的公開信,並呼籲明令禁止「攻擊性自主武器」。

在阿根廷布宜諾艾利斯舉行的人工智能國際會議(International Joint Conference on Artificial Intelligence)上,由特斯拉汽車(Tesla)的聯合創辦人伊隆‧馬斯克(Elon Musk)、蘋果公司聯合創辦人史蒂夫‧沃茲尼克(Steve Wozniak)、Google收購的人工智慧新創公司DeepMind首席執行長Demis Hassabis、物理學大師史蒂芬‧霍金(Stephen Hawking)與一千多位研究人工智能與機器人的技術人員,共同簽署了這份公開信件。

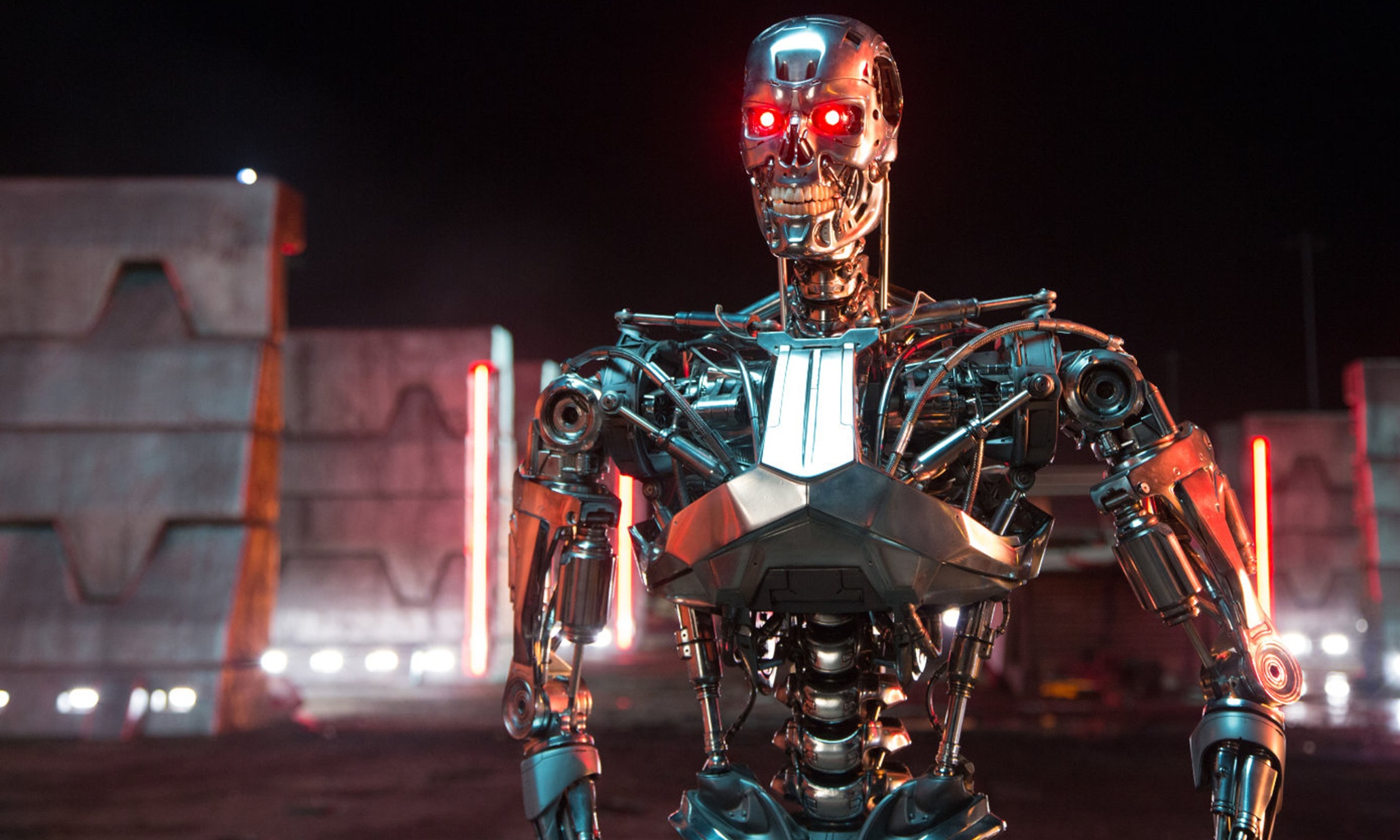

信中指出:「人工智能技術已經涉及到自主武器的佈署。事實上,如果沒有法律因素,這種技術並非幾十年,而是幾年內就可成真。然而這個賭注是很高的:自主性武器已經被形容為繼火藥與核武器之後,戰爭武器中的第三次革命。」

人工智慧(AI)雖然確保了軍事人員能在戰場中更安全的地方,但自主性武器是由自我意識操作,觸發戰爭的門檻更低,可能會造成人類生活更大的損失。

如果一個軍事大國開始發展可選擇目標的武器系統,並且不經人為控制,由武器自主經營,那麼它將會啟動一個類似原子彈的軍備競賽;然而,與核武器不同的是,人工智慧製造過程沒有特別難取得的自然資源,而且很難被人為監測。「這種人工技術軌跡的終點是顯而易見的:自主武器將成為明日的AK-47突擊步槍(容易製造且殺傷力強大)。現今,人們所面對的關鍵問題是:我們是否要啟動一個全球性的人工智能軍備競賽?或者事先防止它的開始呢?」信中說道。

新南威爾斯大學人工智慧教授托比‧沃爾許(Toby Walsh)說:「今天的決定將塑造人類的未來、決定著我們是否遵循誠實的原則。我們支持一些人權組織的要求,希望聯合國能夠禁止自主性武器,就像最近禁止致盲的雷射武器一樣。」

馬斯克和霍金也提出警告,人工智慧將「是我們最大的生存威脅」,研發完善的人工智慧可能是一場「招致人類終結的競賽」;但是其他人,包括蘋果聯合創始人沃茲尼克最近則改變了對人工智慧的看法,他表示機器人將會給人類帶來好處,可以使他們變得像「家庭寵物,並且提供無時不刻的照顧。」

四月份在日內瓦舉行的聯合國會議中,討論到戰爭武器的未來,其中包括所謂的「殺手機器人」,儘管有來自各界的不同組織施予壓力,並展開「停止開發殺手機器人運動」,但像英國這類強權仍然反對自主武器的開發禁令。

原文報導出處

最新文章

最新文章 主題總覽

主題總覽 成為粉絲

成為粉絲 追蹤IG

追蹤IG 追蹤推特

追蹤推特 也有串串

也有串串 合作提案

合作提案